Project Origin: Bientôt un système de watermark anti-fake news sur les articles de presse?

La Trusted News Initiative (TNI), une alliance entre des médias et des Gafas pour lutter contre la désinformation, a annoncé la création d'un système de filigrane pour mieux identifier les contenus journalistiques originaux et fiables et les distinguer des fake news: Project Origin.

Créée en 2019 à l'initiative de la BBC, la TNI se veut une sorte d'effort de coopération et de mise en commun des outils de lutte contre les fake news mis en place par différents médias dans le monde ainsi que les géants de la tech comme Google et Facebook.

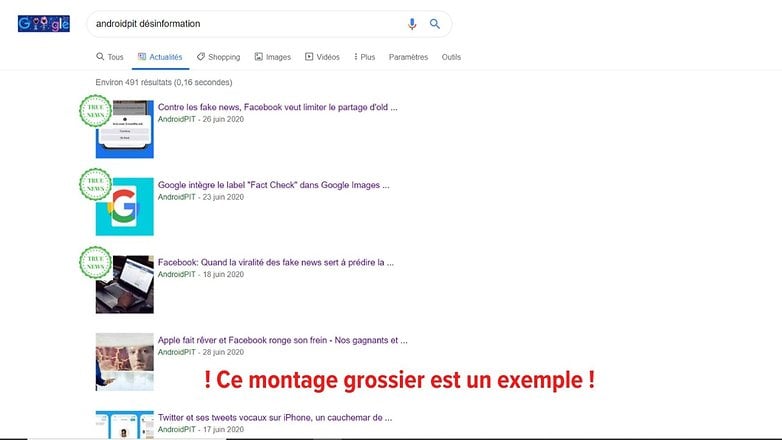

Dans un communiqué publié lundi 13 juillet et passé quelque peu inaperçu, la BBC a annoncé, dans le cadre de cette initiative TNI, la création de Project Origin. Concrètement, il s'agirait de mettre en place un système de watermark ou filigrane, à la manière de ceux présents sur les photos de banques d'images, par exemple, pour mieux identifier les contenus journalistiques fiables.

Un label anti-fake news évolutif avec un code couleur?

Ces watermark seraient donc appliqués sur les contenus journalistiques originaux publiés par les médias membres de la TNI pour mieux les identifier. Project Origin est une nouvelle approche pour lutter contre la désinformation en détectant la manipulation du contenu et en authentifiant la source du contenu.

"Si les marques, styles et autres indicateurs de confiance traditionnels restent essentiels, ils ne suffisent plus à garantir la légitimité du contenu. Des documents modifiés ou synthétiques peuvent parfois sembler provenir de sources journalistiques réputées, ce qui peut donner l'impression que des documents faux ou trompeurs sont crédibles", nous explique-t-on dans le communiqué de la BBC.

Project Origin attache donc un filigrane numérique aux contenus provenant d'un éditeur authentique, un filigrane qui se dégrade lorsque le contenu a été manipulé ou altéré. Le public verra un petit indicateur de couleur accompagné d'un message sur le contenu ou dans le navigateur. Cela permet de s'assurer que le public sait que le contenu, comme une vidéo par exemple, a été réellement produit par sa source présumée et n'a pas été manipulé à d'autres fins.

La BBC, qui se fait porte-parole de ce projet, explique que "cette approche technologique pourrait potentiellement devenir un garde-fou automatique des contenus trompeurs manipulés ou contrefaits si elle est largement adoptée."

En revanche, aucun détail n'a encore été donné sur ce à quoi ressemblerait cette technologie ni comment elle pourrait être mise en place à l'échelle des moteurs de recherche ou des réseaux sociaux. La BBC se contente de dire que "la TNI s'occupera du prototype, définir les standards et les spécifications qui seront rendus publics en septembre prochain."

Que pensez-vous d'un tel dispositif? Pensez-vous qu'un sceau de validation "anti-fake news" apposé sur un article ou une vidéo et qui se dégrade à mesure qu'on l'altère est une bonne idée? Faites-le nous savoir en commentaires.

À lire également sur AndroidPIT France:

Source : BBC

-

Admin

14 juil. 2020 Lien du commentaireDes Golden News aujourd'hui , que des Golden News demain, la lutte contre les avis divergents ...oups les Fake News a bon dos, c'est mon avis en plus que Facebook n'est pas ma mère , ni Google non plus d'ailleurs et que je m'en balle de leurs avis