Look to Speak: L'application de Google transforme le regard en langage

Lire dans d'autres langues :

Avec une nouvelle application Android d'accessibilité, Google veut aider les personnes souffrant de troubles moteurs et de la parole à communiquer avec leur regard.

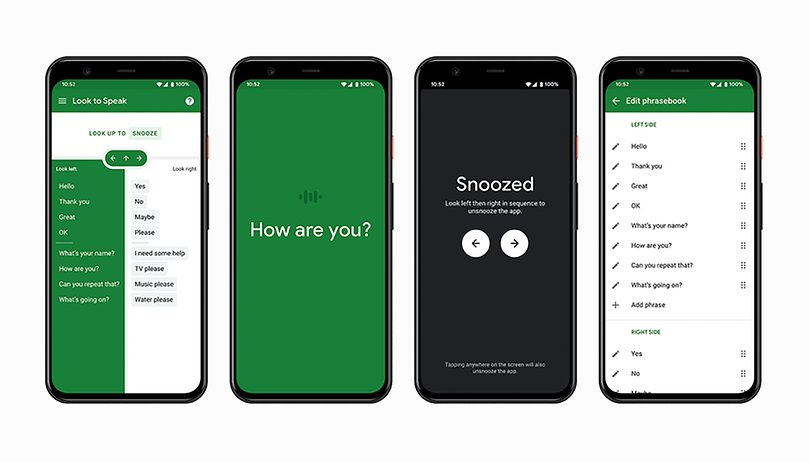

Compatible avec Android 9.0 et plus, y compris Android One, il suffit d'orienter votre smartphone légèrement en deçà de vos yeux, comme si vous vouliez prendre un selfie en contre-plongé. Il faut alors regarder à droite ou à gauche pour éliminer les propositions qui ne vous intéressent pas et arriver à celle de votre choix.

Huit expressions, personnalisables et interchangeables, sont à votre disposition à gauche et à droite de l'écran. Chaque fois que votre regard balaye dans une direction ou une autre, les lots d'expressions sont divisés par deux et changent de côté jusqu'à ce qu'il ne reste plus que celle que vous voulez lancer.

Richard Cave, orthophoniste chez Google, décrit dans le message comment un petit groupe de l'entreprise a expérimenté les capacités des smartphones actuels. L'application, baptisée "Look to Speak", permet aux utilisateurs de sélectionner des phrases prédéfinies à l'aide de leurs yeux, qui sont ensuite prononcées par le smartphone. L'application peut être téléchargée depuis le Google Play Store gratuitement.

"Look to Speak": “Un regard est dans tout pays un langage"

Le contrôle de la voix se fait uniquement par les mouvements des yeux. La surface de l'application est divisée en trois zones. Selon que vous déplacez vos yeux vers la gauche ou vers la droite, des groupes de phrases correspondants sont sélectionnés, qui sont affinés peu à peu jusqu'à ce que vous atteigniez la phrase souhaitée. Une recherche vous permet de passer au début de la sélection.

Google permet aux utilisateurs de personnaliser les phrases comme ils le souhaitent, afin qu'elles soient mieux adaptées à leurs besoins personnels. Cependant, cette personnalisation ainsi que le réglage fin de la reconnaissance visuelle ne peuvent être réalisés par le contrôle visuel proprement dit. Ici, Google continue à utiliser un contrôle traditionnel par smartphone.

Google et l'accessibilité avec le projet "Start with One"

L'initiative "Look to Speak" n'est qu'une partie de l'initiative "Start with One" de Google, qui s'inscrit dans le cadre des "Expériences avec Google". Ces projets démarrent - comme leur nom l'indique - avec l'idée qu'ils pourraient initialement aider une seule personne et ne bénéficier qu'ultérieurement à un groupe cible plus large.

Tout ce dispositif repose sur le machine learning. Cela permet la formation d'un modèle d'apprentissage automatique via une interface web sans avoir besoin de savoir programmer.

Richard Cave a déclaré qu'il était fascinant de voir comment Look to Speak pouvait être utilisée dans des situations où d'autres solutions antérieures n'étaient pas disponibles. Il cite en exemple l'utilisation à l'extérieur, dans la circulation, sous la douche ou dans des situations d'urgence. "Maintenant, les conversations peuvent avoir lieu plus facilement quand il y avait du silence auparavant, et j'ai hâte d'en entendre quelques-unes", dit Cave.

À lire également sur NextPit France:

Source : Google, Google Start with One